Das Problem bei KI-Agenten ist nicht nur ihre Leistung, sondern ihre Entscheidungsmacht. Ein Test prüft, ob ein Agent funktioniert. Governance regelt, ob und wie er im Unternehmen handeln darf. Erst mit Mandat, Grenzen, Nachweisbarkeit und Eskalation wird aus Automatisierung ein steuerbares System.

KI-Agenten halten Einzug in Buchhaltung, Support, Marketing und Wissensarbeit. Das Problem ist längst nicht mehr, ob Unternehmen diese Systeme einsetzen. Die eigentliche Frage lautet: Wie wird ihr Handeln steuerbar, nachvollziehbar und verantwortbar? Genau hier beginnt KI-Agenten Governance. Deloitte berichtet 2026, dass nur 21 Prozent der befragten Unternehmen bereits ein ausgereiftes Governance-Modell für autonome Agenten haben. Gleichzeitig zählen die größten Sorgen rund um KI fast durchweg zu Governance-Themen: Datenschutz und Sicherheit, regulatorische Anforderungen, Aufsicht sowie Modellqualität und Erklärbarkeit.

Viele Unternehmen reagieren auf diese Lücke mit Checklisten, Tests oder punktuellen Assessments. Das ist nachvollziehbar, greift aber zu kurz. Ein Assessment beantwortet vor allem, wie gut ein Agent funktioniert. Führung muss jedoch eine andere Ebene beantworten: Unter wessen Mandat handelt der Agent, innerhalb welcher Grenzen, mit welcher Protokollierung und mit welcher Eskalation? Solange diese Fragen offen bleiben, entsteht keine belastbare Governance, sondern nur ein besser dokumentiertes Risiko.

Was KI-Agenten von klassischer Automatisierung unterscheidet

Ein klassischer Workflow tut, was vorher eindeutig festgelegt wurde. Ein KI-Agent dagegen kann Ziele interpretieren, Zwischenentscheidungen treffen, Werkzeuge aufrufen und in mehrstufigen Prozessen eigenständig handeln. Genau deshalb verändert sich die Steuerungslogik. NIST hat im Februar 2026 seine AI Agent Standards Initiative gestartet, um einen vertrauenswürdigen, interoperablen und sicheren Rahmen für agentische Systeme zu fördern. Allein diese Initiative zeigt: Agenten sind nicht bloß ein neues Tool, sondern eine neue Governance-Frage.

Für Unternehmen bedeutet das: Sobald ein System nicht nur Inhalte erzeugt, sondern Aufgaben koordiniert, Aktionen auslöst oder Entscheidungen vorbereitet, reicht reine Qualitätskontrolle nicht mehr aus. Dann geht es um delegierte maschinelle Handlungsmacht. Und delegierte Handlungsmacht braucht Regeln.

Warum ein Assessment allein nicht genügt

Assessments sind sinnvoll. Sie können sichtbar machen, ob ein Agent konsistent antwortet, sauber mit Daten umgeht, Rollen respektiert oder definierte Aufgaben zuverlässig erfüllt. Das ist nützlich – aber es ist nur ein Baustein.

Das strukturelle Problem beginnt dort, wo Unternehmen Assessment und Governance verwechseln. Denn auch ein gut getesteter Agent kann organisatorisch falsch eingebettet sein. Er kann zu viele Berechtigungen haben, unklare Eskalationswege auslösen, stillschweigend Prompt-Änderungen übernehmen oder Entscheidungen vorbereiten, für die niemand sauber verantwortlich zeichnet. Das Risiko liegt dann nicht in der einzelnen Antwort, sondern im Betriebsmodell.

Mit anderen Worten: Ein Assessment sagt, ob ein Agent im Test funktioniert. Governance regelt, ob und wie er im Unternehmen handeln darf.

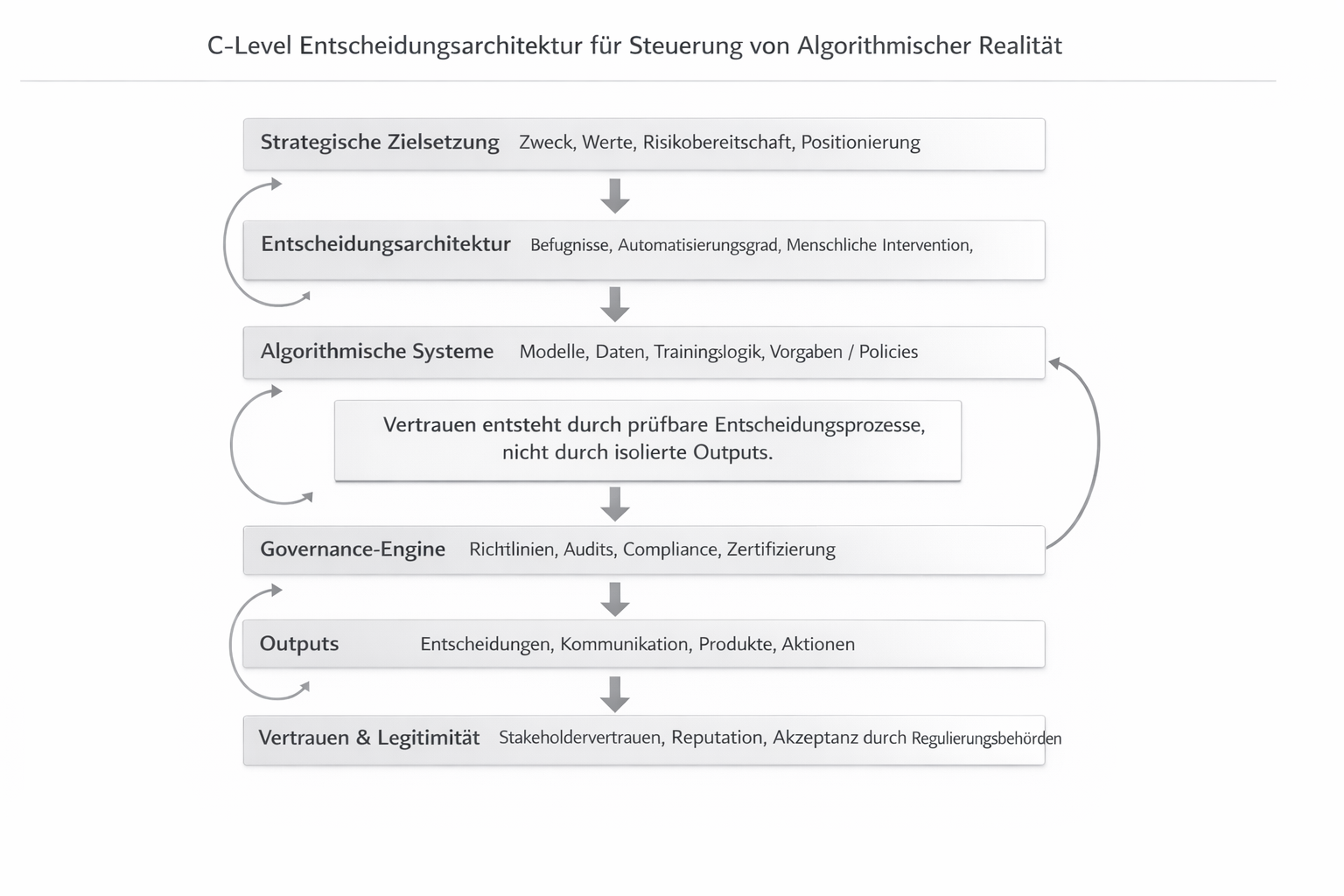

Die Management-Perspektive: Governance als Operating Model

Genau an dieser Stelle wird ISO/IEC 42001 relevant. Die Norm beschreibt kein Einzel-Tool und keine isolierte Kontrollmaßnahme, sondern ein Artificial Intelligence Management System. ISO nennt sie den ersten internationalen Managementsystem-Standard für KI und betont ausdrücklich die Anforderungen an Aufbau, Implementierung, Aufrechterhaltung und kontinuierliche Verbesserung eines solchen Systems. Der Standard zielt damit nicht auf Einzelfallprüfung, sondern auf organisatorische Steuerung, Verantwortlichkeiten, Prozesse und fortlaufende Verbesserung.

Für die Praxis ist das ein wichtiger Perspektivwechsel. KI-Agenten Governance sollte als Operating Model gedacht werden – nicht als Freigabeformular vor dem Rollout. Ein belastbares Modell braucht mindestens fünf Elemente:

- Mandat

Welche Aufgaben darf ein Agent überhaupt übernehmen? Darf er nur vorschlagen, oder auch auslösen, weiterleiten, priorisieren oder entscheiden? - Grenzen

Welche Daten, Systeme und Entscheidungsspielräume sind erlaubt – und wo endet die Autonomie? - Nachweisbarkeit

Welche Eingaben, Werkzeuge, Zwischenschritte und Outputs werden protokolliert, damit Entscheidungen später prüfbar bleiben? - Eskalation

Wann greift Human-in-the-Loop? Wer stoppt, korrigiert oder übernimmt? - Change Control

Wie werden Prompt-Änderungen, Tool-Anbindungen, Rollenwechsel oder Modellupdates freigegeben und dokumentiert?

Ohne diese Architektur bleibt Governance reaktiv. Dann bewertet das Unternehmen Symptome, aber nicht die Steuerungslogik des Systems.

Warum das jetzt zur Führungsfrage wird

Die regulatorische Taktung erhöht den Druck zusätzlich. Die Europäische Kommission führt den Zeitplan des EU AI Act weiter: Das Gesetz trat am 1. August 2024 in Kraft, die Verbote bestimmter Praktiken und Pflichten zur AI Literacy gelten seit 2. Februar 2025, GPAI-bezogene Governance-Regeln seit 2. August 2025, und die volle Anwendbarkeit ist grundsätzlich auf 2. August 2026 angelegt, mit längeren Übergängen für bestimmte Hochrisiko-Systeme.

Für Unternehmen heißt das nicht, dass jeder interne Agent automatisch unter dieselben Pflichten fällt. Es heißt aber sehr wohl, dass Governance, Dokumentation, Zuständigkeiten und Risikologik keine spätere Kür mehr sind. Wer agentische Systeme skaliert, bevor diese Fragen beantwortet sind, baut operative Reichweite ohne gleichwertige Steuerbarkeit auf.

Gerade für Mittelständler ist das relevant. Denn sie führen KI-Agenten oft pragmatisch ein: nah am Prozess, nah an der Fachabteilung, schnell im Nutzen. Das ist häufig richtig. Aber genau dann muss die Organisation klären, welche Freiheiten sie delegiert – und welche nicht.

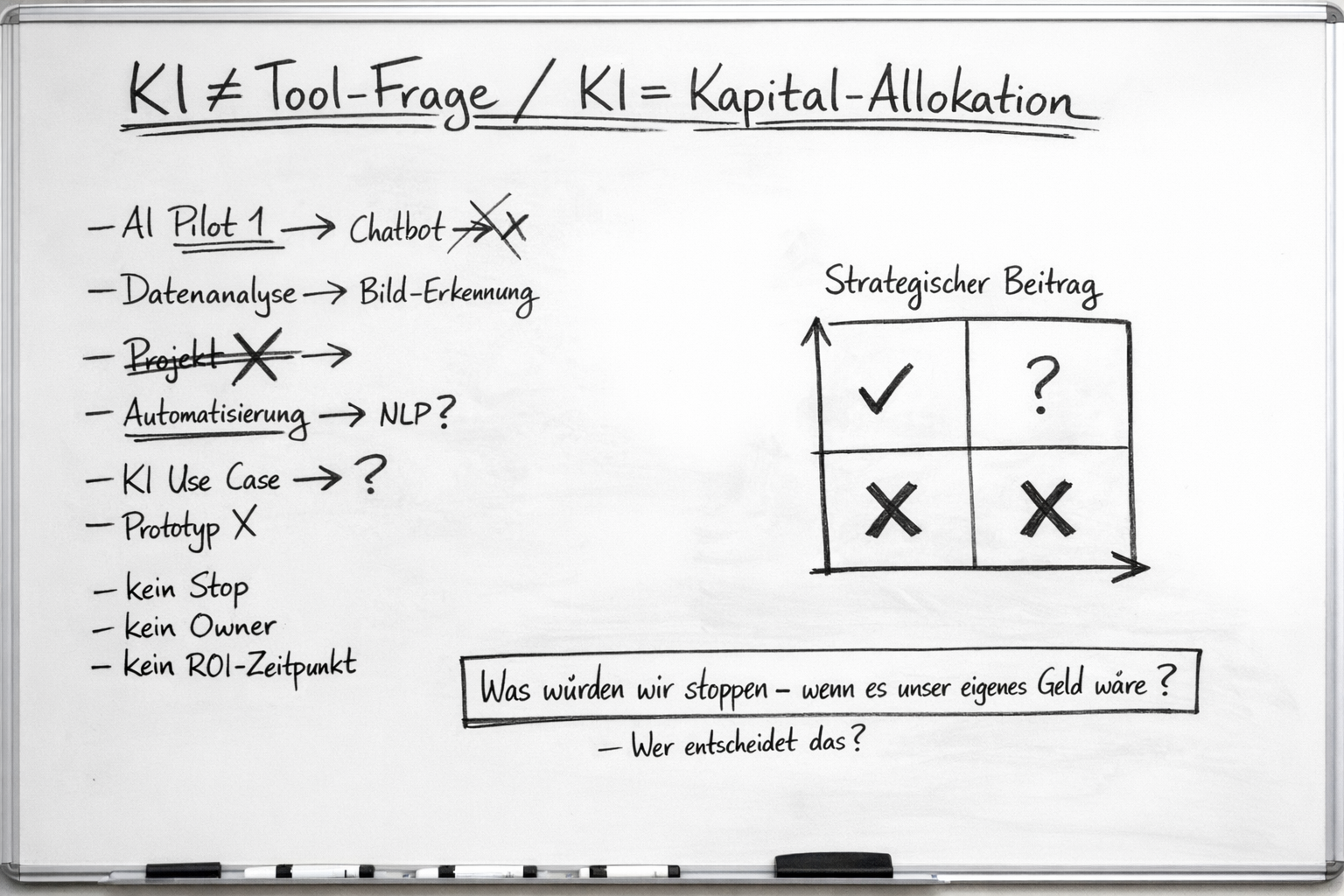

Ein praxistauglicher Denkrahmen für Unternehmen

Ein hilfreicher Grundsatz lautet: Nicht der Agent ist das Governance-Objekt, sondern sein Handlungsspielraum im organisatorischen Kontext.

Das verändert auch die Einführungslogik. Die erste Frage sollte nicht lauten: „Welches Tool ist das beste?“ Sondern:

Welche Entscheidungen, Aktionen und Informationsflüsse wollen wir überhaupt an ein System delegieren?

Daraus ergibt sich ein einfaches Reifeprinzip:

Zuerst Use Case und Risiko klären.

Dann Rollen, Rechte und Grenzen definieren.

Dann Protokollierung und Eskalation festlegen.

Erst danach sollte ein Agent technisch skaliert werden.

So wird Governance nicht zum Bremsklotz, sondern zur Voraussetzung dafür, dass Automatisierung nicht nur schneller, sondern auch belastbarer wird.

Fazit

Die Debatte über KI-Agenten wird oft technisch geführt. Für Unternehmen ist sie in Wahrheit organisatorisch. Nicht die Frage, ob ein Agent überzeugend wirkt, entscheidet über seine Tauglichkeit. Entscheidend ist, ob sein Handeln mandatiert, begrenzt, nachvollziehbar und steuerbar ist.

Ein Assessment kann dafür ein sinnvoller Startpunkt sein. Der eigentliche Reifegrad zeigt sich aber erst dort, wo Governance zum Operating Model wird.

Was ist KI-Agenten Governance?

KI-Agenten Governance beschreibt die Regeln, Rollen, Kontrollen und Nachweise, mit denen Unternehmen den Einsatz autonom oder teilautonom handelnder KI-Systeme steuern. Dazu gehören Mandat, Berechtigungen, Protokollierung, Eskalation und laufende Überwachung.

Reicht ein KI-Agenten-Assessment aus?

Nein. Ein Assessment kann Qualität, Sicherheit und Zuverlässigkeit prüfen. Es ersetzt aber kein organisatorisches Steuerungsmodell für Verantwortung, Grenzen, Freigaben und Änderungen.

Welche Norm oder Orientierung ist für Unternehmen relevant?

ISO/IEC 42001 ist der zentrale internationale Managementsystem-Standard für KI. Für das regulatorische Umfeld in Europa ist zusätzlich der Zeitplan des EU AI Act relevant.